摘要:

本文系统讲解 Dify 工作流的核心概念、操作方法与实际应用场景,面向零基础或初级 AI 开发者。文章介绍了 AI 工作流、Prompt、LLM、大语言模型节点、Question Classifier、HTTP Request 接口调用节点和模板节点等核心名词,结合内容审核、客服和多语言翻译场景进行现实案例解析。通过详细步骤指导,读者可以在 Dify 平台上创建完整工作流,实现多任务分支处理、调用外部系统和统一输出格式。文章还提供通用模板和落地案例,强调工作流是 AI 从“能想”到“能做”的关键工程化方法,为团队构建长期可维护的 AI 应用提供实践指南。

引言:为什么“会用模型”已经不够了?

随着大语言模型能力不断增强,AI 应用的门槛正在降低,但真正可落地的 AI 产品却越来越依赖工程能力。

在实际业务中,仅靠一个 Prompt 已无法解决以下问题:

- 多种用户需求混合在同一个入口

- 不同任务需要不同处理逻辑

- 需要接入外部系统与真实数据

- 输出结果必须稳定、可复用

这正是 Dify 工作流(Workflow) 发挥价值的地方。

一、什么是 Dify?一句话说明白

Dify 是一个面向应用层的 LLM 应用开发平台,帮助开发者和产品人员,用低代码方式将大模型能力,组合成真正“能干活”的 AI 应用。

如果做一个类比:

模型 ≈ 大脑

Dify ≈ 操作系统

工作流 ≈ 行为流程与执行规则

二、核心名词详解(结合现实理解)

1️⃣ AI 工作流(Workflow)

通俗解释:

AI 工作流是一套预先设计好的执行流程,用来规定 AI 在不同场景下“该做什么、不该做什么”。

它的核心不是“让 AI 更聪明”,而是让 AI 更可控。

现实案例:

在内容审核场景中:

- 用户提交内容

- 工作流判断是否为广告

- 若是广告 → 标记并提示修改

- 若不是 → 进入内容优化流程

没有工作流,这些判断只能靠一次 Prompt 碰运气。

2️⃣ Prompt(提示词)

通俗解释:

Prompt 是一次性告诉 AI“你现在要做什么”。

为什么 Prompt 不够用?

- 无法处理多分支逻辑

- 不适合调用外部系统

- 结果难以标准化

现实对比:

- Prompt:临时口头安排

- 工作流:标准作业流程(SOP)

3️⃣ LLM(大语言模型)

通俗解释:

LLM 是 AI 负责“理解、推理和生成”的核心引擎。

在 Dify 中,LLM 并不是全部,而是工作流中的一个“执行节点”。

现实案例:

在客服系统中,LLM 负责:

- 理解用户问题

- 提取关键诉求

- 生成自然语言回复

而是否升级工单、是否转人工,则由工作流逻辑决定。

4️⃣ 节点(Node)

通俗解释:

节点是工作流中的最小功能单元,每个节点只负责一件事。

为什么要拆成节点?

- 逻辑更清晰

- 易调试

- 易扩展

现实类比:

就像工厂流水线,每个工位只负责一个动作,而不是整条生产线。

5️⃣ Question Classifier(问题分类节点)

通俗解释:

用于判断用户输入属于哪一类任务。

常见分类:

- 内容摘要

- 翻译

- 查询

- 咨询

现实案例:

企业知识助手中:

- “帮我总结这份文档” → 摘要流程

- “这个制度怎么执行?” → 问答流程

6️⃣ HTTP Request(接口调用节点)

通俗解释:

用于让 AI 调用外部系统或服务。

现实应用:

- 查询天气

- 调用翻译接口

- 对接企业 CRM / ERP 系统

这一步,让 AI 不再只“会说话”,而是真正“能办事”。

7️⃣ Template(模板节点)

通俗解释:

用于将零散的结果,整理成统一格式输出。

常用场景:

- 自动报告

- 客服标准回复

- 内容发布模板

示例:

【用户问题】

{{ question }}

【处理结果】

{{ result }}

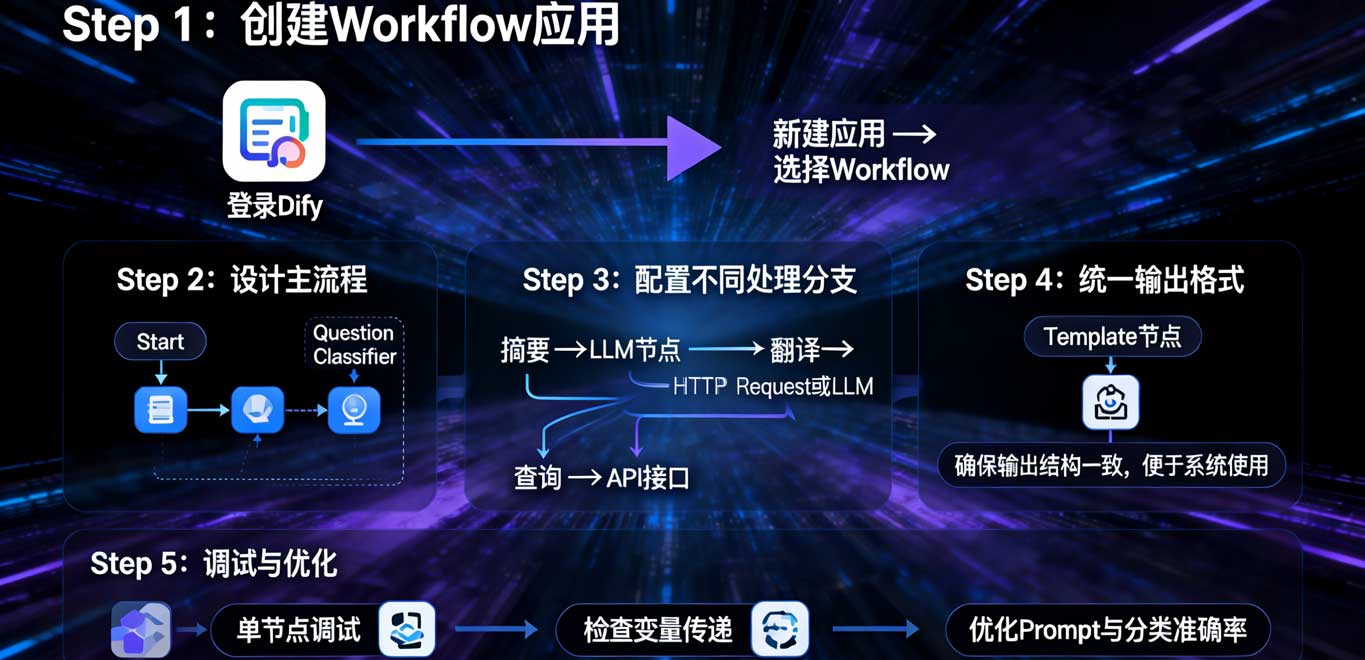

三、如何用 Dify 搭建一个完整工作流?

Step 1:创建 Workflow 应用

- 登录 Dify

- 新建应用 → 选择 Workflow

Step 2:设计主流程

Start

↓

Question Classifier

Step 3:配置不同处理分支

- 摘要 → LLM 节点

- 翻译 → HTTP Request 或 LLM

- 查询 → API 接口

Step 4:统一输出格式

- 使用 Template 节点

- 确保输出结构一致,便于系统使用

Step 5:调试与优化

- 单节点调试

- 检查变量传递

- 优化 Prompt 与分类准确率

四、【通用 Dify 工作流模板】

适用于大多数 AI 应用场景:

Start

↓

Question Classifier

├─ 摘要 → LLM_Summary → Template → End

├─ 翻译 → HTTP_Translate → Template → End

└─ 查询 → HTTP_Query → Template → End

五、真实落地案例:内容运营 AI 助手

应用能力:

- 自动摘要长文

- 多语言翻译

- 统一发布格式

实际效果:

- 减少人工处理时间

- 提升内容一致性

- 降低培训成本

结语:工作流,是 AI 走向工程化的关键一步

模型决定了 AI 能“想到什么”,

而工作流决定了 AI 能“做到什么”。

Dify 的价值,正在于将大模型能力工程化、流程化、产品化。

对于希望构建长期可维护 AI 应用的团队来说,理解并掌握 Dify 工作流,是一条必经之路。

| 比较维度 | LangChain | Dify | Coze |

|---|---|---|---|

| 可定制性 | ⭐⭐⭐⭐⭐(深度可控) | ⭐⭐⭐(中等) | ⭐⭐(低) |

| 易用性 / 上手难度 | ⭐⭐(需开发能力) | ⭐⭐⭐⭐(低代码) | ⭐⭐⭐⭐⭐(最易上手) |

| 扩展性 / 集成能力 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐ |

| 部署速度 | ⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| 适合场景 | 复杂企业应用、研发团队 | 企业内部流程、知识库应用 | 客服、对话机器人、快速原型 |

| 生态与社区 | ⭐⭐⭐⭐⭐(最活跃) | ⭐⭐⭐ | ⭐⭐ |

| 成本 | 中高(开发与维护成本) | 中等(按服务付费或企业版) | 低至中等(低代码平台订阅) |

| 适用人群 | 开发者 / 技术团队 | 产品经理 / 企业业务人员 / 低代码用户 | 快速部署团队 / 客服人员 / 非技术用户 |